Yapay zeka hizmetleri fotoğraftaki bir kişiyi açığa çıkarıyor

Yapay zekaya (AI) dayalı hizmetler internette popülerlik kazanıyor ve fotoğrafta gösterilen kişilerin soyunmasına olanak tanıyor. Yalnızca geçtiğimiz Eylül ayında 24 milyon kişi bu tür uygulamaları kullandı.. Uzmanlara göre bu tür hizmetler saldırganların çeşitli suçları işlemesine yardımcı olabiliyor. “Soyunma” uygulamalarının tehlikeleri ve bu tehditlerden kendinizi nasıl koruyacağınızla ilgili ayrıntılar için İzvestia’nın yazısını okuyun.

Sıyırma eğilimi

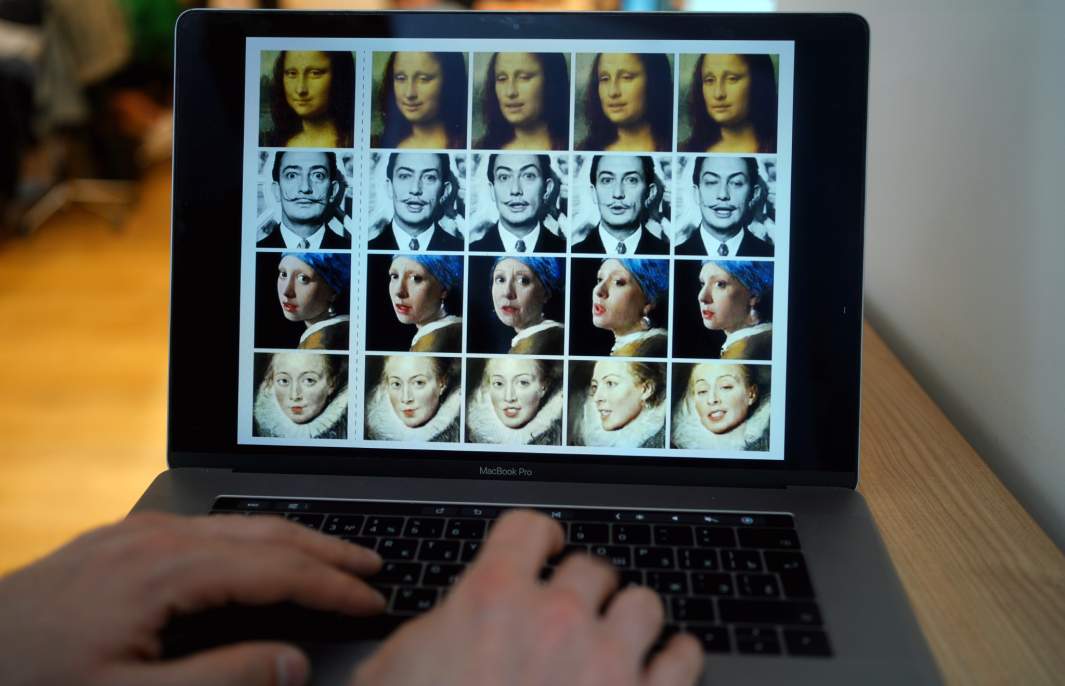

Milyonlarca insanın yapay zeka tabanlı “soyunma” hizmetlerini kullanması, rapor edildi Bloomberg ajansı, analitik şirket Graphika’nın bir araştırmasına atıfta bulundu. Uzmanlara göre, kullanıcılar, sahiplerinin izni olmadan sosyal ağlardan fotoğraf çekiyor ve yapay zeka kullanılarak oluşturulan deepfake’lerin çok gerçekçi olduğu ortaya çıkıyor.

Aynı zamanda, Graphika uzmanlarının da belirttiği gibi, bu hizmetlerden bazıları yalnızca kadınların “soyunma” fotoğraflarında uzmanlaşmıştır. Üstelik bunlar yalnızca halka açık olmakla kalmıyor, aynı zamanda çeşitli platformlarda da aktif olarak tanıtılıyor. Böylece, X sosyal ağında (eski adıyla Twitter) ve Reddit’te yayınlanan bu tür hizmetlere olan bağlantıların sayısı 2023’ün başından bu yana %2400 arttı.

X’in temsilcileri Bloomberg’e kadınları “soymaya” yönelik hizmetlere ilişkin reklamlarla ilgili yorumlarını hemen iletemedi. Aynı zamanda Reddit, platformunun “her türlü yanlış, cinsel içerikli materyallerin izinsiz değişimini” yasakladığını belirtti ve gelecekte bu tür reklamları engelleyeceğine söz verdi.

İçgüdülerin iradesiyle

Gazinformservice’in altyapı BT çözümleri koruma grubunun başkanı Sergei Polunin, insanları “soyunan” hizmetlerin popüler olmasının nedeninin insan doğasının değişmemesi olduğunu söylüyor. Uzmana göre, En ihtiyatlı tahminlere göre küresel İnternet trafiğinin %30’u pornografiden geliyor. Bu alandaki yeni bir trend, deepfake’lerin yaratılmasıdır.

“Deepfake” kavramı birkaç yıl önce ortaya çıktı. Bu kelime, Derin Öğrenme – derin öğrenme ve Sahte – sahte olmak üzere iki anlamın bir araya gelmesiyle oluşmuştur. Mirey Robotics’in kurucusu ve CEO’su yapay zeka uzmanı Andrey Natashkin, fotoğraflarda insanları “soymanıza” olanak tanıyan teknolojinin, deepfake kategorisinden makine öğreniminin bir başka olumsuz tezahürü haline geldiğini belirtiyor.

Sergei Polunin, Izvestia ile yaptığı röportajda “‘Soyunma’ hizmetlerini kullananların çoğunluğunun tam olarak saldırgan olduğundan emin değilim” diyor. — Burada çok daha basit bir insani ilgi var.

Ancak kamusal alanda kışkırtıcı fotoğrafların yalnızca varlığı bile genellikle bir kişi için sorun teşkil ediyor. Polunin’e göre tek istisna, bir kişinin erotik fotoğraflardan geçimini sağlaması veya bunların yarattığı görüntünün bir parçası olması durumu olabilir. Aynı zamanda, gerçek fotoğraflara dayanarak oluşturulan deepfake’ler günümüzde hala mükemmel olmaktan uzaktır.

Ancak Polunin’in tahmin ettiği gibi, Sahtelik konusuna olan doğal ilgi göz önüne alındığında, gerçekçiliklerinin arttırılması yakın gelecek meselesidir. İstenilen karakterlerle anahtar teslimi erotik filmler veya görseller oluşturmak büyük olasılıkla popüler bir hizmet haline gelecektir.

Uzman, “İlginç bir nokta, kurbanların kural olarak kendileriyle “çıplak” deepfake’ler oluşturulduğunu bilmemeleridir: çoğu zaman kullanıcılar bunları kendi kişisel amaçları için yaparlar” dedi. “Fakat gerçek saldırganlardan bahsediyorsak durum tamamen farklılaşabilir.

Dolandırıcılar için araç

Andrey Natashkin’in dediği gibi, Günümüzde yapay zeka tabanlı çözümler kullanan dolandırıcılık gerçek bir patlama yaşıyor: Sinir ağları halihazırda sahte pasaportlar, ehliyetler ve banka ekstreleri oluşturabiliyor. Makine öğrenimine dayalı teknolojiler, insan seslerini kolayca kopyalayabiliyor ve sinir ağları, sosyal ağlardaki metin gönderilerini analiz ederken kullanıcıların iletişim şeklini taklit edebiliyor.

“Soyulmuş” deepfake’lerin oluşturulması, dolandırıcıların elindeki başka bir tehlikeli araç haline geldi. Phillips’in yapay zeka uzmanı ve kıdemli ürün müdürü, bu tür görüntülerin suçlular tarafından hedef odaklı taciz, şantaj ve çıplak görüntüler oluşturmak amacıyla, bu görüntülerin sahibi olanların izni olmadan kullanılabileceğini söylüyor. Anastasia Moskovchenko.

burada Bu tür görüntülerin oluşturulmasının kolaylığı ve tespit edilmesinin zorluğu, onları siber zorbalık ve diğer dijital şiddet türleri için güçlü bir araç haline getiriyor. Aynı zamanda, halka açık bir kişiden bahsediyorsak durum daha da kötüleşir – bu durumda itibara yönelik ciddi riskler ortaya çıkar.

— Birkaç yıl önce Amerika Birleşik Devletleri Çok yankı uyandıran bir durum vardı” diyor Andrei Natashkin. — İnternette Amerikan Kongresi Temsilciler Meclisi konuşmacılarından Nancy Pelosi’nin yer aldığı bir video ortaya çıktı. Pelosi sözlerini telaffuz etmekte zorlandı ve düşünceleri karıştı.

Uzmana göre, politikacının sadece sarhoş olduğu ve skandal videonun neredeyse Pelosi’nin siyasi kariyerine mal olduğu yönünde tam bir izlenim yaratıldı. Bunun deepfake olduğunu kanıtlaması oldukça uzun zaman aldı. Muhatap şunları belirtiyor: Asıl sorun, aslında mağdurun korunmasına yönelik yasal dayanakların olmamasıdır, çünkü günümüzün hukuk alanı bu tür durumlara hazır değildir.

Sergei Polunin, popüler sosyal ağların ve popüler sitelerin kesinlikle bu tür içerikleri engellemeye ve bunları yayınlayan kullanıcıları belirlemeye çalışacağına inanıyor. Ancak geçmiş yıllardaki deneyimlerin gösterdiği gibi, bunun durumu değiştirmesi pek mümkün değil: ilerleme, bu kadar tuhaf biçimlerde bile durdurulamaz.

Koruma Mekanizmaları

Anastasia Moskovchenko’ya göre, Bugün TikTok ve Meta şirketi (Rusya Federasyonu’nda aşırılıkçı olarak tanındı ve yasaklandı), soyunma (“soyunma”) anahtar kelimesini engellemeye başladı. Ancak sosyal platformlarda içerik denetimi ve anahtar kelime engelleme gibi teknolojik çözümler uygulanırken bunların etkinliği henüz değerlendirilmiş değil.

— Rus mevzuatının henüz bu konuda belirli bir tutumu yoktur., diyor İzvestia’nın muhatabı. “Ancak küresel eğilim, teknolojinin neden olduğu bu tür gizlilik ihlalleriyle mücadele etmek için yasal bir çerçeve oluşturma ihtiyacına işaret ediyor.

Moskovchenko’ya göre, bir kişinin imajının deepfake oluşturmak için izinsiz kullanılması, psikolojik travmaya, itibarın zedelenmesine ve hem kişisel hem de mesleki ilişkilerde hasara yol açabilir. Buna karşılık Sergei Polunin şunu belirtiyor: Deepfake’in kalitesi düşükse ve kişinin olumlu bir dijital ayak izi ve iyi bir itibarı varsa, skandallardan ve sorunlardan kaçınılabilir.

– Aynı zamanda Bu dijital şiddet biçiminin geniş kapsamlı sonuçları olabilir ve uzun vadeli zihinsel sağlık sorunlarına yol açabilir.,” diye vurguluyor Anastasia Moskovchenko.

Aynı zamanda bugün bu tür olaylara karşı koruma sağlayacak etkili araçlar da yok: Sergei Polunin’in açıkladığı gibi elbette onur, haysiyet ve ticari itibarın korunması için dava açabilirsiniz, ancak siber uzayda bu oldukça zor olacaktır. bunu veya bu görüntüyü kimin yarattığını belirleyin. Aynı zamanda Anastasia Moskovchenko’ya göre deepfake mağdurları için hukuki tavsiyenin yanı sıra ruh sağlığı uzmanlarından destek almak da önemli adımlar olabilir.