Sinir ağlarına suçları tahmin etme öğretildi

Bilim insanları, suçları tahmin edebilen, tahmin doğruluğu %82’yi aşan bir yapay zeka (AI) modeli oluşturdu; Sistem, erken video kayıtlarına, bir dizi davranışsal faktöre ve istatistiğe dayanarak öğreniyor ancak uzmanlar, bu tür sinir ağlarındaki hataların maliyetinin çok yüksek olabileceğini belirtiyor. İzvestia makalesinde suçları tahmin etme yeteneğine sahip yapay zekanın beklentileri ve riskleri hakkında daha fazla bilgi edinin.

İleride oynamak

Güney Kore Elektronik ve Telekomünikasyon Araştırma Enstitüsü’ndeki (ETRI) bilim insanları, suçları tahmin edebilen bir yapay zeka modeli oluşturdu. rapor edildi Tech Xplore baskısı. Dejaview adı verilen yeni sistem, ilk video kayıtlarından bir dizi davranış ve istatistik öğreniyor.

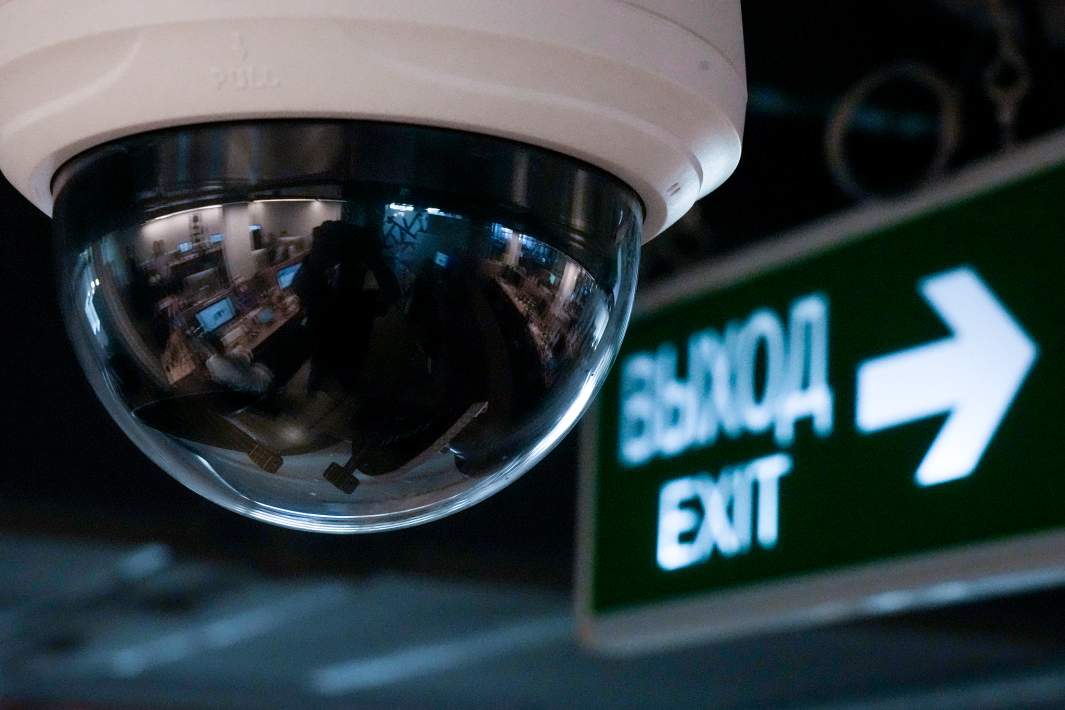

Video kayıtlarını analiz edip suç işleme risklerini gerçek zamanlı olarak değerlendirebildiği gibi birçok faktörü değerlendirerek suç oranlarındaki artışı da tahmin edebiliyor. Sinir ağı özellikle halka açık yerlerdeki insanların davranışlarını suçluların davranışlarıyla karşılaştırarak inceliyor. Dejaview aynı zamanda kabahat türleri ile yasa ihlalleri arasında da ayrım yapıyor.

ETRI uzmanlarına göre, testler sırasında yeni model birçok suçu %82’nin üzerinde bir doğrulukla tahmin etti. Üstelik özelliklerinden biri, belirli bir kişinin davranışını derinlemesine analiz etme ve nüksetmeyi önlemek için eylemlerini kontrol etme yeteneğidir. Sistem geliştiricileri, Dejaview’in ticari versiyonunu 2025 yılı sonunda piyasaya sürmeyi planlıyor.

R-Vision makine öğrenimi teknolojilerinin geliştiricisi Anastasia Perkova, Izvestia ile yaptığı röportajda “Yapay zekaya dayalı bir sistem, bir kolluk kuvvetinin rutin eylemlerini otomatikleştirmenin bir yolu olarak düşünülmelidir” diyor. “Örneğin böyle bir aracın çalışması, suç tekrarı yüzdesini azaltmak amacıyla eski mahkumların veya gözetim altındaki kişilerin operasyonel olarak izlenmesine yardımcı olabilir.

Rus umutları

Bugün Rusya’da halka açık yerlerde güvenliği sağlamak için yapay zeka tabanlı teknolojiler zaten kullanılıyor. T1 AI (T1 Holding) başkanı Sergei Golitsyn’e göre, bu tür sistemler silahları ve tehlikeli nesneleri tanıyabiliyor ve ardından sorumlu kişilere uyarı gönderebiliyor.

İzvestia’nın muhatabı, “Akıllı video analiz sistemleri, insanların tehlikeli davranışlarını tanıyabiliyor ve holiganlık veya suç teşkil eden eylemlerde bulunma risklerini değerlendirebiliyor” diyor. “Ancak karmaşık kontrol ağları oluştururken iki önemli faktöre dikkat edilmelidir.

Sergei Golitsyn, bu faktörleri, öncelikle bilgilerin toplanmasını, saklanmasını ve işlenmesini düzenleyen kişisel verilere ilişkin mevzuata uygunluğu ve ikinci olarak, kamuya açık önemli yerlerde kullanılması gereken bu tür sistemlerin etkinliğini içermektedir. Aynı zamanda, yalnızca video akışı değil, aynı zamanda gözlem nesnesinin sosyal ağlardaki davranışı da dahil olmak üzere diğer yönler de analiz edildiğinde, sözde çok modluluktan maksimum etki elde edilebilir.

Anastasia Perkova’ya göre, ETRI tarafından geliştirilenlere benzer sistemler Rusya’da ancak iyi geliştirilmiş bir düzenleyici çerçeve olması durumunda kullanılmalıdır. Ek olarak, uzmanın belirttiği gibi, şu anda yapay zeka tabanlı sistemlerin güvenliğinin yasal düzenleme açısından hala “gri” bir alan olduğunu dikkate almak önemlidir.

Uzman, “Yine de halka açık yerlerde yüz tanıma sistemleri her yıl daha fazla bölgede uygulanıyor ve yakın gelecekte benzer gelişme yolları onları bekleyebilir” diye düşünüyor.

Öğrenme Araçları

Güney Koreli bilim adamlarının deneyimlerinin gösterdiği gibi, suçları tahmin edebilecek sistemler oluşturmak için çok sayıda eğitim materyaline ihtiyaç var. FACCT’de bilgi güvenliği uzmanı Nikolai Stepanov’un Izvestia ile yaptığı röportajda belirttiği gibi, bugün bu konuda bir eksiklik yok: büyük şehirlerde, bir kişinin ev ile iş arasındaki her adımı kameraya yakalanıyor, internetteki her istek ilk önce bir sağlayıcıdan geçer ve mağazadaki her satın alma işlemi bankada bir kayıt olarak kalır.

Uzman, “Zorluk dijitalleşmenin farklı düzeylerinde yatıyor: örneğin, küçük kasabalarda yüz tanıma özelliğine sahip kameralar ve birçok hizmet sağlayıcı olmayabilir, bu da birleşik bir izleme sistemi kurmayı zorlaştırıyor” diyor.

Anastasia Perkova, yasa ihlallerine ilişkin tarihsel verilerin suç tahmin sistemleri için önemli bir veri kaynağı olabileceğini ekliyor: medya dosyalarının arşivleri (örneğin, video kamera kayıtları) ve ayrıca çözülmüş ve çözülmemiş suçlarla ilgili bilgiler de dahil olmak üzere olayları açıklayan raporlar .

Fakat, Ortaya çıkan önemli bir soru, kolluk kuvvetlerinin bu tür bilgileri geliştiricilerle paylaşmaya ne kadar istekli olduğudur. Ek olarak, herhangi bir sinir ağı, doğru çalışmayı kontrol etmek ve sürdürmek için nitelikli uzmanlardan zorunlu desteğin yanı sıra, tanıma kalitesini artırmak için ek eğitim gerektirir.

Uzman, “Suç tahmini durumunda modeller eğitiliyor ve şüphelilerin veya saldırganların kişisel verileri, yüzlerin ve sesli mesajların yer aldığı video kamera kayıtları da dahil olmak üzere hassas bilgilerle çalışıyor” diyor. — Buna dayanarak, ilgili tüm süreçlerin yalnızca özel teknik araçlar ve organizasyonel güvenlik önlemlerinin yardımıyla değil, aynı zamanda kolluk kuvvetleri tarafından da korunması gerekir.

Nikolai Stepanov, bu tür sistemleri çalıştırırken temel soruların, onları tam olarak kimin eğiteceği ve nelerin tehlikeli davranış olarak kabul edilmesi gerektiği olduğuna dikkat çekiyor. Her halükarda böyle bir mekanizma, çok fazla hukuki çalışma ve mevzuatın güncellenmesini gerektirecektir. Ancak her platformda olduğu gibi hatalar içerebilir.

Arka taraf

Sergei Golitsyn, suç tahmin sistemlerini uygularken karşılaşılan asıl zorluğun teknolojilerin kendisi değil, insanların onlara aşırı güveni olabileceğini söylüyor. Uzmana göre kameraların kişinin davranış kalıplarının yalnızca bir kısmını etkileyebileceğini anlamak önemli. Bu tür yapay zeka modellerinin eğitildiği veri setlerine de dikkat etmelisiniz.

Angara Security’nin hizmet yönetimi direktörü Pavel Pokrovsky, Izvestia ile yaptığı röportajda, “Bir suçun işareti değil, (bir kişinin) bir özelliği olan bazı antisosyal davranış örnekleri var” diyor. — Burada Tourette sendromu olarak adlandırılan, bir kişinin antisosyal davrandığı bir durumu hatırlayabiliriz: örneğin, başlı başına bir idari suç olan müstehcen bir dili kamuya açık bir şekilde ifade etmek.

Uzmanın belirttiği gibi Tourette sendromu psikiyatrik bir tanıdır, bir hastalıktır. Hastanın eylemleri suç kapsamına girmiyor ancak otomatik yapay zeka algoritmaları oldukça farklı kararlar verebiliyor. Anastasia Perkova da eğitim verilerinde önyargı riski gibi bir soruna dikkat çekiyor.

Gerçek şu ki, suçlara ilişkin tarihsel veriler, katılımcıların doğasına veya özelliklerine göre eşit olmayan bir şekilde dağıtılabilir ve bu da yasal ve etik standartların ihlal edilmesine yol açabilir. Diğer bir tehlike ise, yapay zeka tabanlı modellerin giriş verileri üzerinde bir tür kötü niyetli etki olan, düşmanca saldırılar olarak adlandırılan saldırılardır.

Anastasia Perkova, “Suç verileriyle çalışırken bu kritik önem taşıyor; bir saldırgan, AI sisteminin giriş verilerini manipüle ederek olay soruşturmasının gidişatını etkileyebilir” diye vurguluyor.

Pavel Pokrovsky’ye göre günümüzde yapay zeka tabanlı suç tahmin teknolojileri, konunun organizasyonel ve hukuki yönlerinin ilerisindedir. Teknik olarak bu tür tahminler halihazırda gerçeğe dönüşüyor olsa da, sinir ağlarının sonuçlarını kimin, nasıl ve ne şekilde yorumlayacağına dair sorular hala cevapsız kalıyor. Ve bu çok önemlidir, çünkü insanların kaderi bazen kanun uygulama çalışmaları bağlamında yapay zekanın sonuçlarına bağlı olabilir.